Per quasi vent’anni, la parola d’ordine nel mondo IT aziendale è stata una sola: cloud. Migra tutto, scala senza limiti, paghi solo quello che usi. Un mantra ripetuto da ogni fornitore di servizi, da ogni consulente, da ogni slide di presentazione. Eppure, oggi qualcosa sta cambiando in modo silenzioso ma profondo: un numero crescente di aziende sta facendo retromarcia, riportando carichi di lavoro nei propri data center. È il fenomeno della cloud repatriation, e vale la pena capire perché sta accadendo.

Il mito del cloud economico

Quando Amazon Web Services, Microsoft Azure e Google Cloud hanno iniziato la loro scalata verso il dominio del mercato, la promessa era chiara: basta capital expenditure, basta server da comprare, basta sale server da raffreddare. Solo costi operativi, prevedibili, scalabili. Per le startup e le medie imprese era una rivoluzione.

Il problema è che la realtà, nel tempo, ha raccontato una storia diversa.

I costi del cloud pubblico crescono in modo sottile e spesso invisibile. Il trasferimento dei dati (egress) tra regioni o verso l’esterno ha un prezzo. Le istanze lasciate accese per errore o per dimenticanza si accumulano silenziosamente in bolletta. Le licenze software su istanze cloud costano più che su hardware fisico. E man mano che i carichi di lavoro crescono e si stabilizzano, il modello “pay-as-you-go” diventa meno conveniente rispetto a un investimento fisso ammortizzato su tre o cinque anni.

Alcune analisi del settore hanno stimato che aziende di medie dimensioni possono ridurre del 30–50% la spesa IT spostando carichi di lavoro stabili e prevedibili dall’infrastruttura cloud verso sistemi locali. Non è un caso isolato: è un trend.

Le ragioni tecniche del ritorno

Oltre ai costi, ci sono motivazioni tecniche e strategiche che spingono verso il ritorno all’on-premise.

Latenza e performance. Per applicazioni che richiedono reattività in tempo reale — sistemi di controllo industriale, elaborazione video, analisi finanziaria ad alta frequenza — la distanza fisica tra il dato e il processore conta. Un data center locale elimina la variabilità della rete pubblica e garantisce latenze costanti e prevedibili.

Sovranità del dato. Il GDPR europeo e normative equivalenti in altri paesi hanno reso la questione della residenza dei dati non più un dettaglio tecnico ma un requisito legale. Sapere esattamente dove si trovano fisicamente i propri dati — e poterlo dimostrare — è molto più semplice con un server in sede che con un bucket distribuito tra tre availability zone.

Controllo sulla sicurezza. Il cloud pubblico è sicuro, ma la superficie di attacco è diversa da quella di un’infrastruttura privata. Violazioni di accesso, configurazioni errate di bucket S3, credenziali IAM compromesse: sono incidenti comuni e documentati. Molte organizzazioni preferiscono gestire direttamente il proprio perimetro di sicurezza, anche perché questo consente audit interni più granulari.

Vendor lock-in. Dopo anni passati a costruire pipeline su servizi proprietari di un singolo hyperscaler, ci si accorge di quanto sia difficile — e costoso — migrare altrove. L’on-premise, abbinato a software open source, riduce la dipendenza da un singolo fornitore.

L’approccio ibrido: il vero futuro

Sarebbe ingenuo sostenere che il cloud stia per scomparire. Non è così, e probabilmente non sarà mai così. Quello che sta emergendo è un modello maturo e pragmatico: l’infrastruttura ibrida.

L’idea è semplice: non tutto deve stare nello stesso posto. I carichi di lavoro con requisiti prevedibili e costanti — database aziendali, ERP, sistemi gestionali, archiviazione a lungo termine — trovano la loro collocazione naturale su hardware locale, dove il costo per gigabyte elaborato è significativamente più basso. I carichi variabili, stagionali o sperimentali — campagne di marketing digitale, ambienti di sviluppo e test, picchi improvvisi di traffico — sfruttano invece l’elasticità del cloud pubblico.

Questo approccio richiede però competenze nuove: non basta saper amministrare server Windows o Linux, né basta saper usare la console di AWS. Serve capire come connettere i due mondi in modo sicuro, come replicare i dati tra ambienti diversi, come automatizzare il provisioning su entrambi i fronti.

Cosa significa per i team IT

Per chi lavora sul campo nella gestione dei sistemi informatici aziendali, questo trend ha implicazioni concrete.

La figura del sistemista “puro cloud” comincia a perdere appeal, mentre torna di moda la competenza infrastrutturale tradizionale: virtualizzazione on-premise con VMware o Proxmox, gestione di storage NAS e SAN, Active Directory, backup fisici, configurazione di switch e firewall. Competenze che negli ultimi anni sembravano destinate all’obsolescenza ritrovano centralità.

Al tempo stesso, chi ha investito nella formazione cloud non deve preoccuparsi: la conoscenza di Kubernetes, Terraform, o dei principali servizi AWS rimane preziosa. La differenza è che ora viene applicata in un contesto ibrido, dove le stesse logiche di orchestrazione e automazione si applicano sia all’infrastruttura locale che a quella remota.

Conclusione: il pendolo continua a oscillare

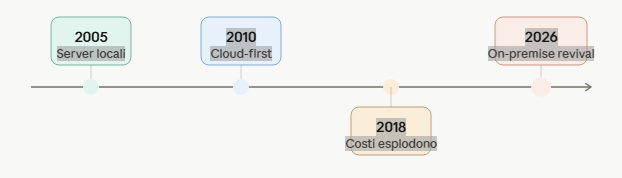

La storia dell’informatica aziendale è una continua oscillazione tra centralizzazione e distribuzione, tra risorse condivise e risorse dedicate. Il mainframe cedette il posto al client-server, il client-server al cloud, e ora il cloud inizia a cedere parte del terreno all’on-premise moderno.

Non è un ritorno al passato. È un’evoluzione. Le aziende più mature stanno imparando a scegliere il modello giusto per ogni carico di lavoro, invece di seguire ciecamente la moda del momento. E forse, questa capacità di valutazione pragmatica è la vera maturità che il settore IT stava cercando.

Come recita l’immagine che circola in questi giorni tra i professionisti IT: “Abbiamo fatto il giro… ed è di nuovo 2005.” Non proprio. Ma un po’ sì.